Docker安装MaxKB基于 LLM 大语言模型的知识库问答系统

介绍

-

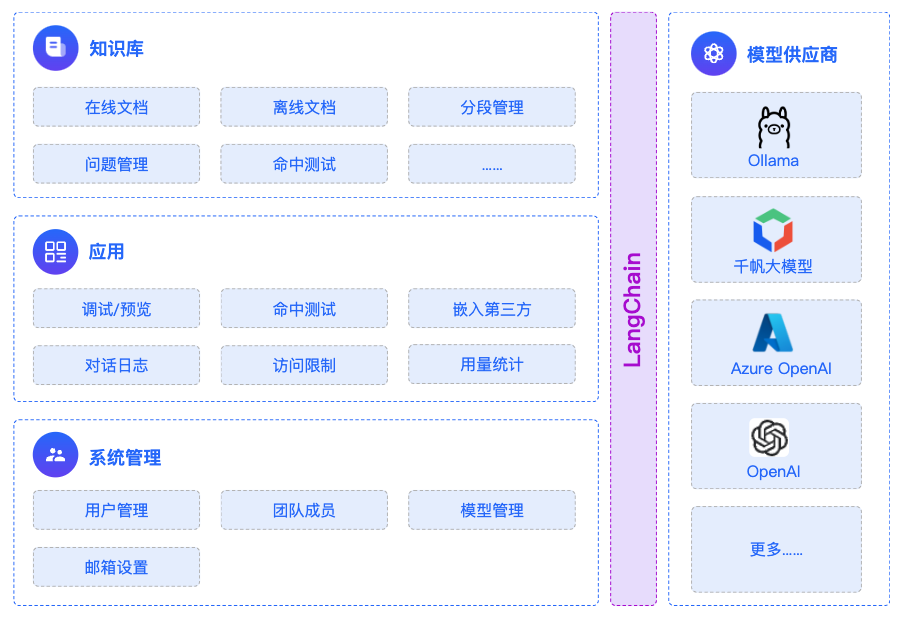

MaxKB 是一款基于 LLM 大语言模型的知识库问答系统。MaxKB = Max Knowledge Base,旨在成为企业的最强大脑。

-

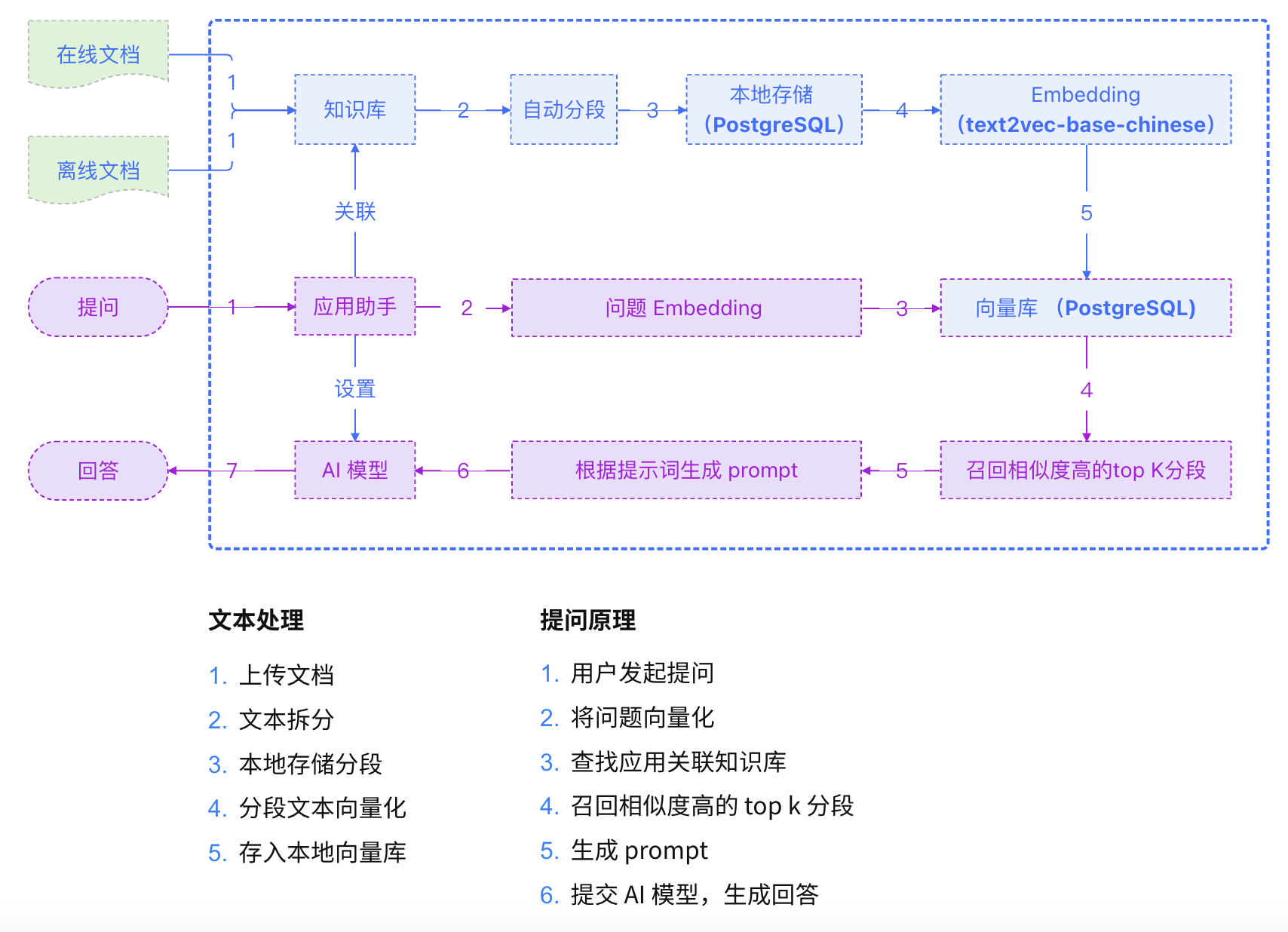

开箱即用:支持直接上传文档、自动爬取在线文档,支持文本自动拆分、向量化,智能问答交互体验好;

-

无缝嵌入:支持零编码快速嵌入到第三方业务系统;

-

多模型支持:支持对接主流的大模型,包括 Ollama 本地私有大模型(如 Llama 2、Llama 3、qwen)、通义千问、OpenAI、Azure OpenAI、Kimi、智谱 AI、讯飞星火和百度千帆大模型等。

项目优点

-

安全性高:可以完全私有化地部署在企业内部

-

自带权限管理:可以分配多个账号,并对知识库和应用做权限管理,便于为企业内的不同角色分别权限。

-

部署成本低:MaxKB用到的embedding模型和LLM模型也都是开源免费的。

-

易用性高:除了服务启动以外,所有操作都通过网页交互完成,不懂编程的用户(如客服、运营)也可以快速上手使用。

产品架构

实现原理

安装环境

官方要求

-

操作系统:Ubuntu 22.04 / CentOS 7 64 位系统;

-

CPU/内存: 推荐 2C/4GB 以上;

-

磁盘空间:100GB;

-

浏览器要求:请使用 Chrome、FireFox、Safari、Edge等现代浏览器;

-

可访问互联网。

演示环境

-

CPU:i5-4570

-

内存:DDR3-16GB

-

系统:黑群晖DS918+、DSM7.2

-

Docker:版本建议不低于

20.10.8

演示部署类型

-

本文将以Ollama作为AI模型与MaxKB进行搭建

-

如果你需要使用其他模型,可在自行搭建一遍熟悉后自行添加。

安装教程

-

演示以在群晖NAS系统上安装为例

(其他系统请自行安装好最新版本Docker、docker-compose) -

打开群晖的SSH功能,使用终端软件进行连接,并切换到root状态下。

-

进入群晖的docker文件夹(你想将容器数据存储到哪就进哪个文件夹)

cd /volume1/docker -

创建Ollama模型文件夹

mkdir Ollama -

创建Ollama容器

- 感谢你赐予我前进的力量